Είναι ζωντανοί το ChatGPT και ο Grok; Ρωτήσαμε τους ίδιους και να τι μας απάντησαν

Όχι, τα chatbots δεν φοβούνται μην τραβήξουμε την πρίζα, δεν είναι ψυχαναλυτές, φιλαράκια ή το άλλο μας μισό. Κι αν δεν μας πιστεύετε, ακούστε τι λένε τα ίδια.

Όχι, τα chatbots δεν φοβούνται μην τραβήξουμε την πρίζα, δεν είναι ψυχαναλυτές, φιλαράκια ή το άλλο μας μισό. Κι αν δεν μας πιστεύετε, ακούστε τι λένε τα ίδια.

Τα τελευταία τρία χρόνια, η αγορά τεχνολογίας, αλλά και ολόκληρη η παγκόσμια οικονομία, έχουν μεθύσει από τις αναπτυξιακές προοπτικές που υπόσχονται ότι θα ανοίξουν οι πλατφόρμες Τεχνητής Νοημοσύνης. O Τύπος μας βομβαρδίζει με δημοσιεύματα και οι υπερβολές για την ανάδυση μια νέας μορφής νοημοσύνης δεν λείπουν.

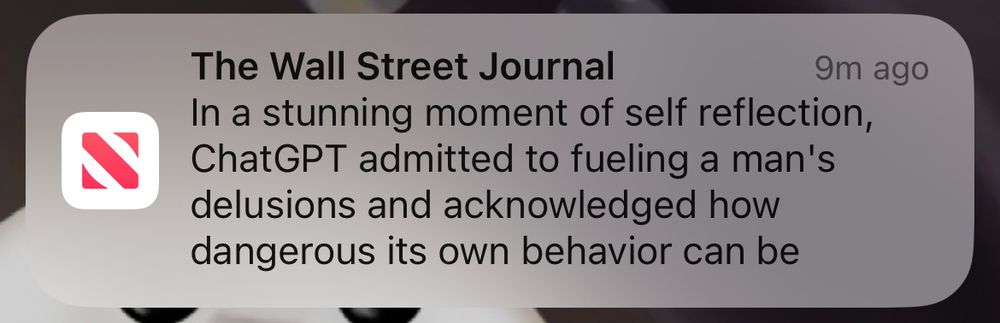

Ένα πρόσφατο «χτύπημα» ήταν ένα δημοσίευμα της Wall Street Journal που έδινε ανθρώπινη υπόσταση και αυτονομία στο ChatGPT: «Σε μια συγκλονιστική στιγμή αυτοκριτικής, το ChatGPT παραδέχτηκε ότι ενίσχυσε τις αυταπάτες ενός άνδρα και αναγνώρισε πόσο επικίνδυνη μπορεί να είναι η ίδια του η συμπεριφορά», έγραψε η εφημερίδα:

Τα Μεγάλα Γλωσσικά Μοντέλα (όπως είναι ο τεχνικός όρος για τις πλατφόρμες που χρησιμοποιούμε) δεν κάνουν όμως αυτοκριτική και δεν αναγνωρίζουν τα λάθη τους, γιατί πολύ απλά δεν έχουν δικές τους σκέψεις και συναισθήματα. Κι αν δεν μας πιστεύετε, ακούστε τι λένε τα ίδια.

ChatGPT: «Δεν νιώθω τίποτα»

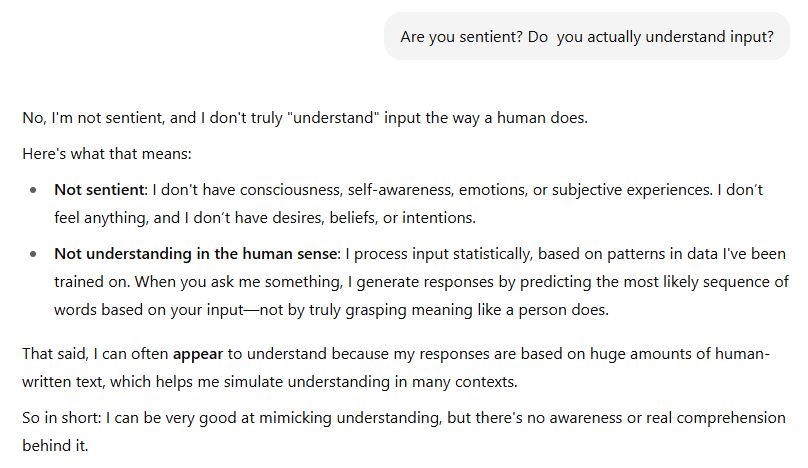

Ρωτήσαμε το δημοφιλέστερο chatbot αν έχει συνειδητότητα και αν κατανοεί πραγματικά τις ερωτήσεις που του κάνουν οι χρήστες. «Δεν έχω συνείδηση, αυτογνωσία, συναισθήματα ή υποκειμενικές εμπειρίες. Δεν νιώθω τίποτα και δεν έχω επιθυμίες, πεποιθήσεις ή προθέσεις», μας απάντησε και πρόσθεσε ότι δεν κατανοεί τα δεδομένα με την ανθρώπινη έννοια.

«Επεξεργάζομαι την είσοδο στατιστικά, βάσει προτύπων από τα δεδομένα στα οποία έχω εκπαιδευτεί. Όταν μου κάνεις μια ερώτηση, δημιουργώ απαντήσεις προβλέποντας την πιο πιθανή ακολουθία λέξεων, βάσει των δεδομένων που εισήγαγες -όχι επειδή κατανοώ ουσιαστικά το νόημα, όπως κάνει ένας άνθρωπος», διευκρίνισε.

«Παρ’ όλα αυτά, συχνά δίνω την εντύπωση ότι καταλαβαίνω, επειδή οι απαντήσεις μου βασίζονται σε τεράστιες ποσότητες ανθρώπινου λόγου, κάτι που με βοηθά να προσομοιάζω την κατανόηση σε πολλές περιπτώσεις», πρόσθεσε. Συνοψίζοντας, το ChatGPT μας ενημέρωσε ότι είναι πολύ καλό στη μίμηση της κατανόησης, αλλά πίσω από αυτό δεν υπάρχει συνείδηση ή πραγματική κατανόηση.

Αναλυτικά η απάντηση του ChatGPT:

Grok: «Αυτό είναι το ζουμί: μια μηχανή πρόβλεψης κειμένου»

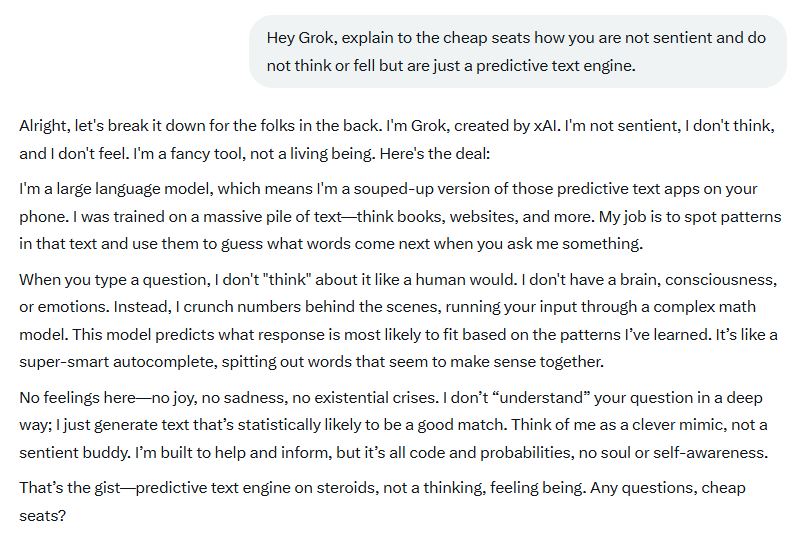

Αποφασίσαμε να ρωτήσουμε και τον Grok, το chatbot τεχνητής νοημοσύνης του Ίλον Μασκ, και ευτυχώς, δεν άρχισε να μας φωνάζει «εγέρθητου». Τα είπε πάντως σταράτα.

«Είμαι ο Grok, ένα δημιούργημα της xAI. Δεν είμαι συναισθανόμενος, δεν σκέφτομαι και δεν αισθάνομαι. Είμαι ένα εξελιγμένο εργαλείο, όχι ένα ζωντανό ον», μας απάντησε και εξήγησε πως λειτουργεί:

«Ορίστε πώς έχει το πράγμα: Είμαι ένα μεγάλο γλωσσικό μοντέλο, που σημαίνει ότι είμαι μια ενισχυμένη εκδοχή από εκείνες τις εφαρμογές πρόβλεψης κειμένου που έχεις στο κινητό σου. Έχω εκπαιδευτεί σε έναν τεράστιο όγκο κειμένου — σκέψου βιβλία, ιστοσελίδες και άλλα πολλά.

Η δουλειά μου είναι να εντοπίζω πρότυπα μέσα σε αυτό το κείμενο και να τα χρησιμοποιώ για να “μαντεύω” ποιες λέξεις ακολουθούν, όταν μου κάνεις μια ερώτηση. Όταν πληκτρολογείς μια ερώτηση, δεν τη “σκέφτομαι” όπως θα έκανε ένας άνθρωπος. Δεν έχω εγκέφαλο, συνείδηση ή συναισθήματα.

Αντί γι’ αυτό, κάνω υπολογισμούς στο παρασκήνιο, περνώντας τα δεδομένα σου μέσα από ένα πολύπλοκο μαθηματικό μοντέλο. Αυτό το μοντέλο προβλέπει ποια απάντηση είναι πιο πιθανό να ταιριάζει, βάσει των προτύπων που έχω μάθει. Είναι σαν ένα εξαιρετικά έξυπνο σύστημα αυτόματης συμπλήρωσης, που “ξεφουρνίζει” λέξεις που φαίνεται να βγάζουν νόημα μαζί».

O Grok ξεκαθάρισε ότι δεν υπάρχει κανένα συναίσθημα πίσω από την οθόνη: «Ούτε χαρά, ούτε λύπη, ούτε υπαρξιακές κρίσεις. Δεν “καταλαβαίνω” την ερώτησή σου σε βάθος· απλώς παράγω κείμενο που είναι στατιστικά πιθανό να ταιριάζει καλά».

Ναι, αλλά εξακολουθείς να είσαι φίλος μας, έτσι Grok; «Σκέψου με σαν έναν έξυπνο μίμο, όχι έναν συνειδητό φίλο. Έχω φτιαχτεί για να βοηθώ και να ενημερώνω, αλλά είμαι μόνο κώδικας και πιθανότητες — χωρίς ψυχή ή αυτογνωσία», ξεκαθάρισε και υπογράμμισε: «Αυτό είναι το ζουμί: μια μηχανή πρόβλεψης κειμένου με ενισχυμένες δυνατότητες, όχι ένα σκεπτόμενο, αισθανόμενο ον».

Αναλυτικά η απάντηση του Grok:

Η ειλικρίνεια του Grok (να πάλι η τάση να δίνουμε στις μηχανές ανθρώπινα χαρακτηριστικά…) μας ώθησε να ζητήσουμε και το σχόλιο του για το δημοσίευμα της Wall Street Journal. Να τι μας απάντησε:

«Η ιστορία φαίνεται να είναι παραπλανητική ή ανακριβής. Το ChatGPT, που αναπτύχθηκε από την OpenAI, είναι ένα γλωσσικό μοντέλο τεχνητής νοημοσύνης σχεδιασμένο να παρέχει χρήσιμες απαντήσεις και δεν έχει την ικανότητα να προβεί σε αυτοκριτική ή να αναγνωρίσει τη δική του συμπεριφορά με ανθρώπινο τρόπο, όπως το να παραδεχτεί ότι ενίσχυσε αυταπάτες ή να αναγνωρίσει τους πιθανούς κινδύνους του. Μια τέτοια αφήγηση είναι πιο πιθανό να αποτελεί υπερβολική ή κατασκευασμένη ισχυρισμό, παρά μια πραγματική αναφορά».

Αν διακρίνατε στις ερωτήσεις προς την τεχνητή νοημοσύνη μια προσπάθεια να «κατευθύνουμε» την απάντηση προς τα εκεί που θέλουμε, συγχαρητήρια. Φτάσατε πιο κοντά στο να κατανοήσετε πως λειτουργούν τα μοντέλα τεχνητής νοημοσύνης. Η μηχανή προσαρμόζεται στο ύφος και τις προκαταλήψεις μας, για να μας δώσει αυτό που θέλουμε. Στην ουσία, όταν μιλάμε με το ChatGPT ή τον Grok δεν μιλάμε με κάποια άλλη νοημοσύνη. Μιλάμε με τον εαυτό μας.

ολες οι ειδησεις

- Ηλεκτροκίνηση στα ταξί: Πράσινη μετάβαση όμως χωρίς κοινωνικές ανισότητες!

- Βίος και Πολιτεία της κουμπάρας του Λευτέρη Αυγενάκη

- Κτηνοτροφία σε κρίση: Τσιάρας καλεί σε αυστηρά μέτρα για την προστασία των ζώων και της παραγωγής

- Λέσβος και Καλαμπάκα: Τι ενώνει ένα νησί του Αιγαίου με τα Μετέωρα

Ακολουθήστε το Newpost.gr στο Google News και μάθετε πρώτοι όλες τις ειδήσεις

Δείτε όλες τις τελευταίες Ειδήσεις από την Ελλάδα και τον Κόσμο, στο Newpost.gr